I dagens skrämmande/häftiga vetenskapliga nyheter har amerikanska forskare tagit ett betydande steg framåt för att skapa datorer som kommunicerar direkt med våra hjärnor.

Neurovetenskapare och talsexperter vid University of California San Francisco (UCSF) har utvecklat en artificiell intelligens som kan läsa mänskliga hjärnvågor och omvandla dem till tal.

Genombrottet, rapporterades först i Natur tidningen, har konsekvenser både för människor som har tillstånd som har kostat dem talkraften (MS eller stroke -drabbade, till exempel), och för den framtida robotapokalypsen. De kan bokstavligen läsa våra tankar nu killar är det dags att oroa sig?

Alla skämt åt sidan, denna teknik är helt banbrytande för sömlös integration av maskiner i mänskliga mekanismer, vilket potentiellt minskar behovet av användarinmatning i programmering. Slutligen förstår MS Paint att det du lyckades skapa IRL inte var faktiskt vad var i ditt huvud.

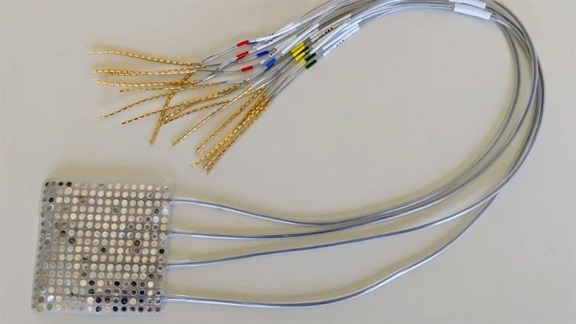

Brainwave to speech intelligence har gjort snabba framsteg under de senaste tio åren efter att tidigare ha stannat kvar vid översättning av rådata från hjärnan till ord. Komplexiteten hos neurologiska vägar och individualiteten hos varje persons hjärnmönster innebar att det i allmänhet bara var möjligt att generera ett ord i taget.

Även om människors tankemönster är unika och oändligt komplexa är signalerna från hjärnan till munnen, käken och tungan som producerar tal ganska universella. Därför, i stället för att bara studera hjärnan, använde UCSF -forskarna två AI: er för att analysera både neurologiska signaler och munens rörelser under dialog.

Videon nedan visar en röntgenbild av hur vår mun och hals verkligen ser ut när vi pratar.

När informationen som samlats in av dessa AI matades in i en synthesizer kom något ut som mer eller mindre liknade komplexa meningar.