在当天的可怕/酷炫科学新闻中,美国科学家在创造与我们的大脑直接通信的计算机方面向前迈出了重要的一步。

加州大学旧金山分校 (UCSF) 的神经科学家和语音专家开发了一种人工智能,能够读取人类脑电波并将其转换为语音。

突破,首次报道在 自然 杂志,对那些因疾病而丧失语言能力的人(例如 MS 或中风患者)以及未来的机器人启示录都有影响。 他们现在可以从字面上读出我们的想法,现在是时候担心了吗?

撇开所有笑话不谈,这项技术对于将机器无缝集成到人类机制中是完全开创性的,有可能减少用户在编程中的输入需求。 最后,MS Paint 会明白您设法创建的 IRL 并不是 通 你脑子里想的是什么。

脑电波到语音智能在过去十年中取得了快速进展,过去在将原始大脑数据翻译成文字方面停滞不前。 神经通路的复杂性,以及每个人大脑模式的个性,意味着通常一次只能生成一个单词。

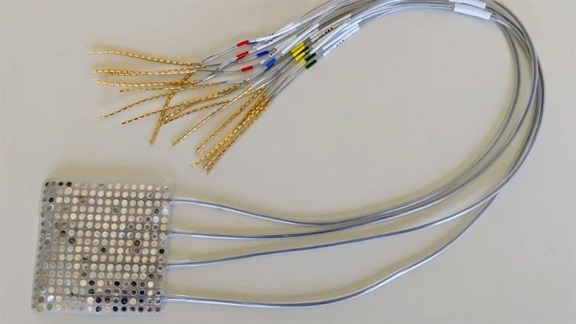

然而,尽管人们的思维模式是独特且无限复杂的,但从大脑到嘴巴、下巴和舌头发出的信号却是相当普遍的。 因此,加州大学旧金山分校的科学家们不是只研究大脑,而是使用两个 AI 来分析神经信号和对话期间嘴巴的运动。

下面的视频向您展示了我们谈话时我们的嘴和喉咙实际上是什么样子的 X 射线视图。

当这些人工智能收集的信息被输入合成器时,就会产生或多或少类似于复杂句子的东西。