En 2019, les deepfakes sont passés d'un passe-temps relativement jovial à une grave menace éthique, calomniant les célébrités et perturbant la politique.

Au cas où vous n'êtes pas familier avec le terme « deepfake », il fait essentiellement référence à la manipulation vidéo et à la réplication de caractéristiques humaines à l'aide d'un logiciel centré sur les principes de l'intelligence artificielle, du suivi des visages et de l'apprentissage en profondeur.

En termes simples, c'est le processus d'imiter les traits de son visage et/ou sa voix pour avoir l'air/sonner réel.

Les réseaux constitués de nœuds interconnectés exécutent de manière autonome des calculs sur les données d'entrée. Avec suffisamment de « formation » des utilisateurs, ces nœuds commencent à s'organiser pour accomplir une tâche spécifique à l'utilisateur. C'est l'apprentissage en profondeur, et il est principalement utilisé pour marier une certaine nature de vidéo avec des images de célébrités, manifestant de manière convaincante un contenu bidon à la volée.

Alors que les programmes de cette nature ont peut-être commencé comme un passe-temps inoffensif sur les dernières pages d'Internet, ils ont maintenant été catapultés dans le grand public ; réutilisé comme un arme diffamatoire pour cibler des célébrités et des personnalités politiques.

Alors, par où tout a-t-il commencé?

Le terme « deepfake » provient d'un utilisateur anonyme de Reddit du même alias qui a pris de l'importance en 2017 en raison d'une série de fausses vidéos pornographiques de célébrités. Mis à part la boîte évidente de vers ouverts par ce contenu invasif et dérangeant, cela donnerait un aperçu des ramifications plus larges de la technologie - encore en cours de traitement aujourd'hui.

C'était le premier cas où un individu était capable de créer rapidement et simplement une imitation humaine convaincante et de haute qualité avec des moyens facilement disponibles. Ce n'était certainement pas le premier contenu « superposé » à pénétrer sur Internet, mais c'était le premier exemple d'un contenu créé si rapidement à l'aide de graphiques grand public.

« deepfake » abritait ces imitations de célébrités dans un seul sous-titre qu'il a créé, et peu de temps après sa conception, les membres ont commencé à apporter leurs propres modifications, principalement des clips vidéo amusants. Une section entière était consacrée à la manifestation de l'acteur toujours mémorable Nicholas Cage dans des films et des émissions de télévision aléatoires.

Le virage dangereux

As beaucoup ont prédit lors de la montée initiale des deepfakes, la technologie allait rapidement inciter à des pratiques plus douteuses sur le plan éthique.

En juin 2018, un programme informatique de création de deepfake, baptisé FakeApp, a pris de l'importance après avoir été mis à disposition pour le téléchargement – il utilisait le même logiciel à l'origine colporté par le deepfake de Reddit.

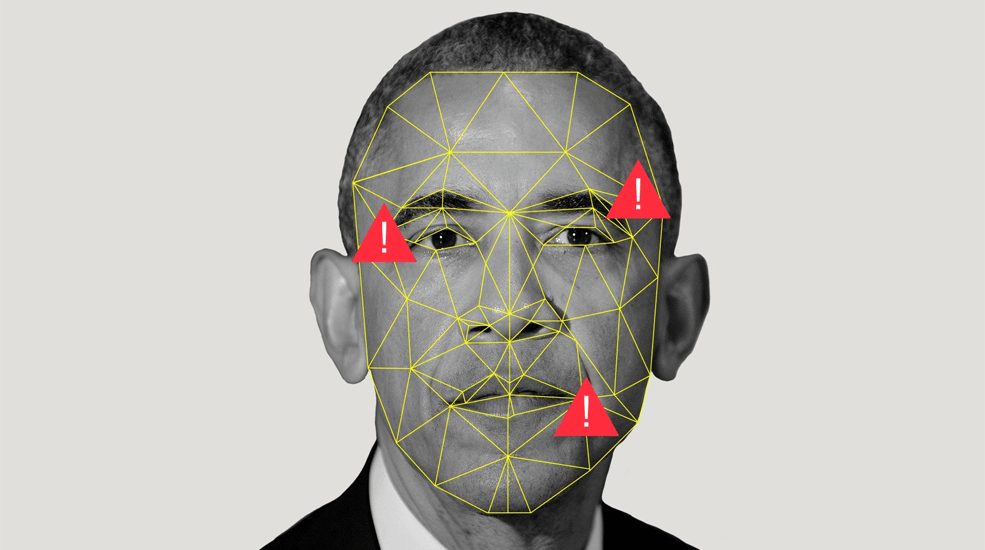

Peu de temps après, plusieurs vidéos sont apparues impliquant des politiciens qui avaient l'intention de tromper les gens en leur faisant croire à des événements et à des déclarations fictifs. Notamment, un parti socialiste flamand nommé spa a publié une vidéo sur leur compte Twitter et Facebook montrant Donald Trump semblant narguer la Belgique pour son maintien dans l'accord de Paris sur le climat.

Alors que la contrefaçon a été détectée par la plupart des téléspectateurs, ceux qui ne sont pas au courant du deepfaking croyait que la vidéo était réelle. Suite à cette révélation, de nombreuses plateformes sociales, dont Twitter, Discord et Gfycat, ont explicitement interdit les deepfakes et toutes les communautés associées, Reddit emboîtant le pas peu de temps après… et Reddit dit rarement « non » à quoi que ce soit.