半个世纪以来,AI“教父”Geoffrey Hinton 培育了 ChatGPT 等聊天机器人的核心技术。 现在,在离开谷歌之后,他警告说它可能会在未来造成严重的伤害。

Geoffrey Hinton 的开创性研究被许多人视为人工智能技术的“教父”,为 ChatGPT 等复杂的生成系统铺平了道路。

这位英裔加拿大人在计算机科学和认知植物学领域积累了半个多世纪的经验。 现在,75岁的他 离开他的职位 在谷歌“揭发”人工智能不断发展所带来的所谓危险。

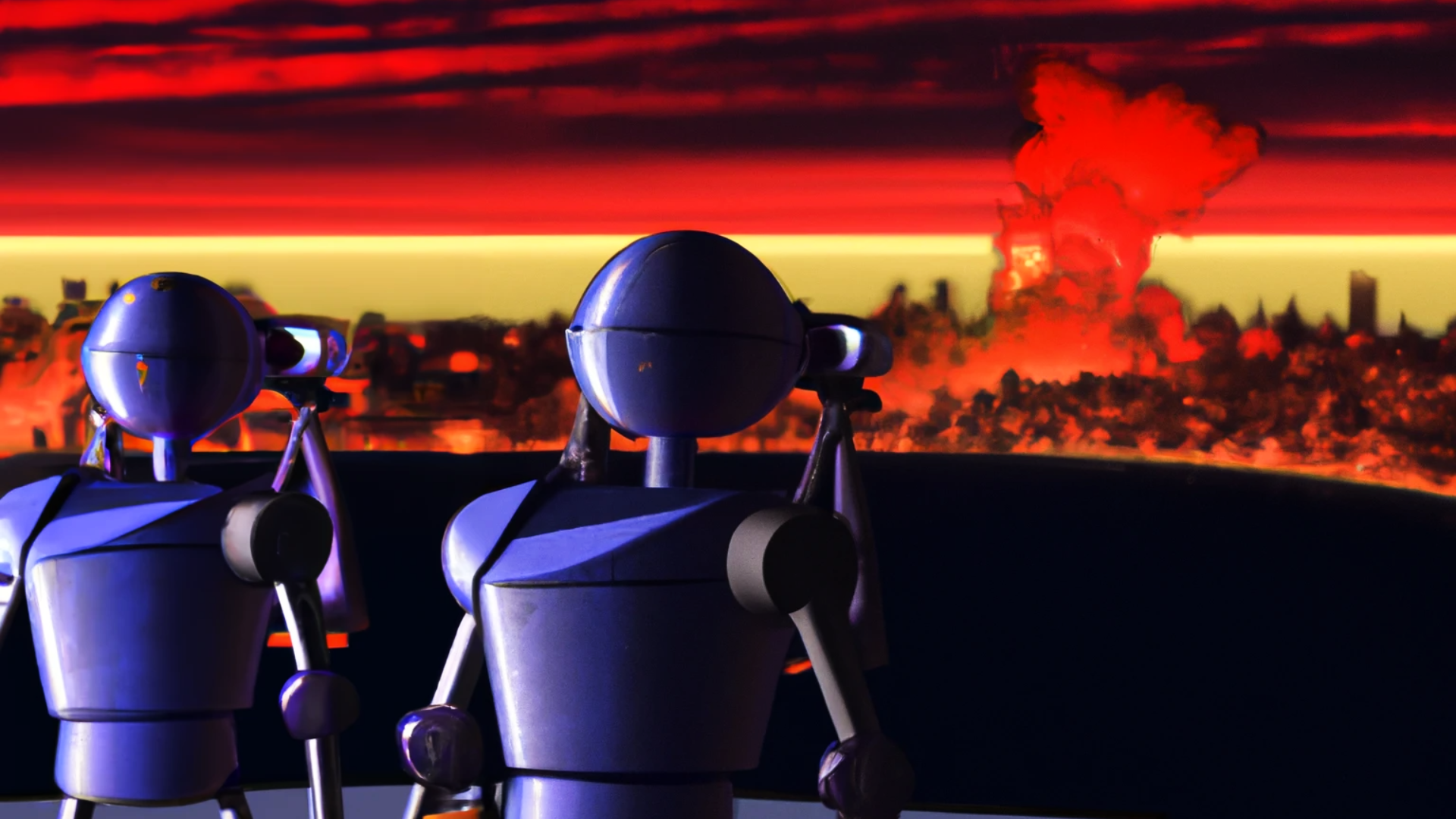

虽然目前,我们中的许多人仍在陶醉于该技术的新颖用途,但他警告说,从现在开始,这些系统将不可避免地学习“操纵人的方式”,并断言它们已经变得比人类更聪明。

如果你想象的未来类似于 Blumhouse 的 naff 恐怖电影 M3GAN,你可能离题很远,但围绕机器学习缺乏监管的存在主义担忧程度正在迅速上升。

欣顿告诉 “纽约时报” 直到去年他才相信谷歌一直是人工智能的“适当管家”,但一旦微软合并,所有谨慎的情绪都被抛弃了 与 Bing 聊天 GPT – 无意中威胁到其谷歌搜索业务。

他告诉 BBC,在闭门造车之前,一些已知的危险“相当可怕”,警告聊天机器人可能变得比人类更聪明,并可能被“坏人”利用。