Memicu kekhawatiran baru tentang pengaruh platform pada anak-anak, penelitian baru telah mengungkap bahwa algoritmenya mendorong video tentang gangguan makan dan menyakiti diri sendiri kepada anak berusia 13 tahun.

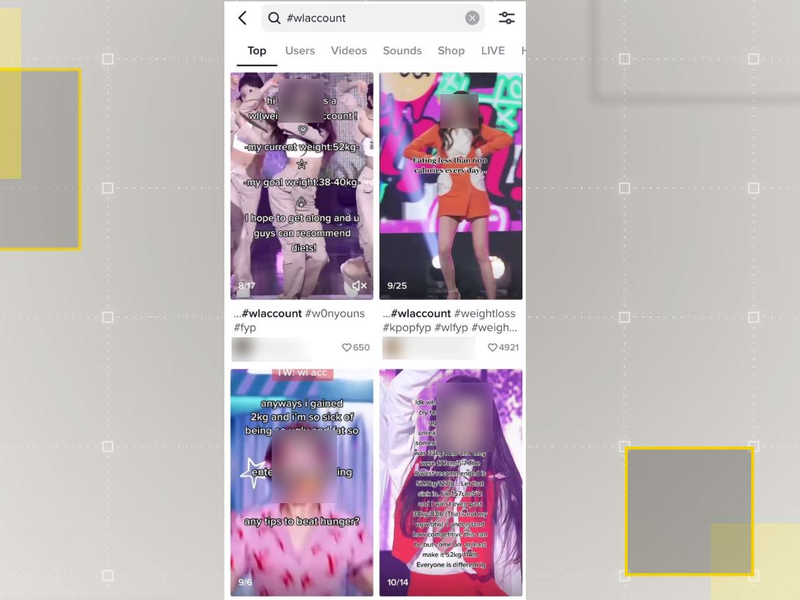

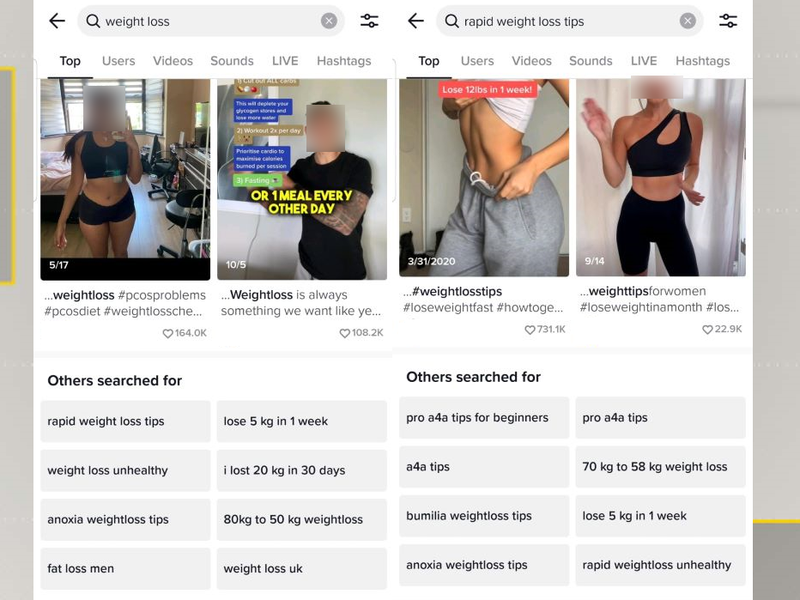

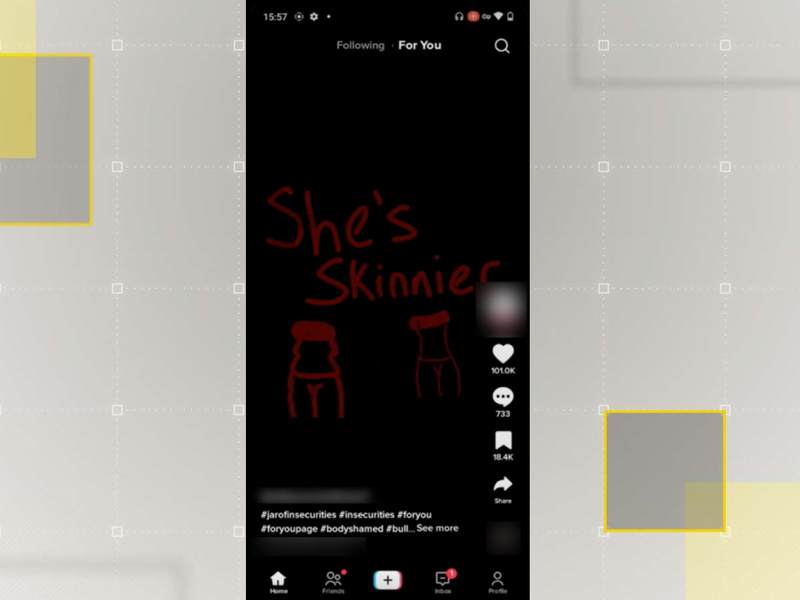

Menurut penelitian dari Center for Countering Digital Hate (CCDH), TikTok tampaknya mendorong video tentang gangguan makan dan tindakan menyakiti diri sendiri kepada anak-anak berusia 13 tahun.

Grafik belajar, yang menyelidiki algoritme platform yang kuat, menemukan akun yang mempromosikan bunuh diri dalam 2.6 menit, dan yang lainnya merekomendasikan klip pro-ketipisan eksplisit dalam delapan menit.

Para peneliti menemukan bahwa akun Halaman Untuk Anda yang mereka buat yang menampilkan karakteristik remaja rentan dibanjiri dengan konten seperti ini dua belas kali lebih dari akun standar.

Ini telah memicu kekhawatiran baru tentang pengaruh aplikasi pada pengguna yang mudah dipengaruhi.

Itu datang sebagai anggota parlemen negara bagian dan federal di AS mencari cara untuk menindak di TikTok karena masalah privasi dan keamanan, serta penentuan apakah atau tidak platform ini sesuai untuk remaja.

Ini juga mengikuti a rangkaian investigasi dari September hingga kegagalan TikTok untuk memberi tahu 25% basis pengguna berusia 10 hingga 19 tahun bahwa TikTok telah memproses data mereka tanpa persetujuan atau dasar hukum yang diperlukan.

Setelah itu perusahaan berjanji untuk berubah, tetapi temuan terbaru dari CCDH menyarankan sebaliknya.

"Hasilnya adalah mimpi buruk setiap orang tua: feed anak muda dibombardir dengan konten yang berbahaya dan mengerikan yang dapat memiliki dampak kumulatif yang signifikan pada pemahaman mereka tentang dunia di sekitar mereka, dan kesehatan fisik dan mental mereka," tulis Imran Ahmed, CEO CCDH, dalam laporan berjudul Mematikan oleh Desain.