Dans un monde où l'IA peut être utilisée pour faire presque n'importe quoi, les étudiants utilisent des algorithmes de langage pour écrire leurs devoirs et contournent les logiciels de plagiat.

À l'âge de 14 ans, je me souviens d'avoir tenté de brouiller mes devoirs de français en utilisant les outils de traduction de Google. Ma pauvre tentative n'a pas réussi à tromper le professeur et je me suis rapidement retrouvé en retenue.

Malgré ma terrible exécution il y a toutes ces années, cependant, il semble que j'aie été en avance sur la courbe.

Avec le boom continu de la technologie de l'IA, qui reste sérieusement non réglementé Soit dit en passant, les étudiants reçoivent des distinctions pour les devoirs et les devoirs de cours construits entièrement par des algorithmes informatiques.

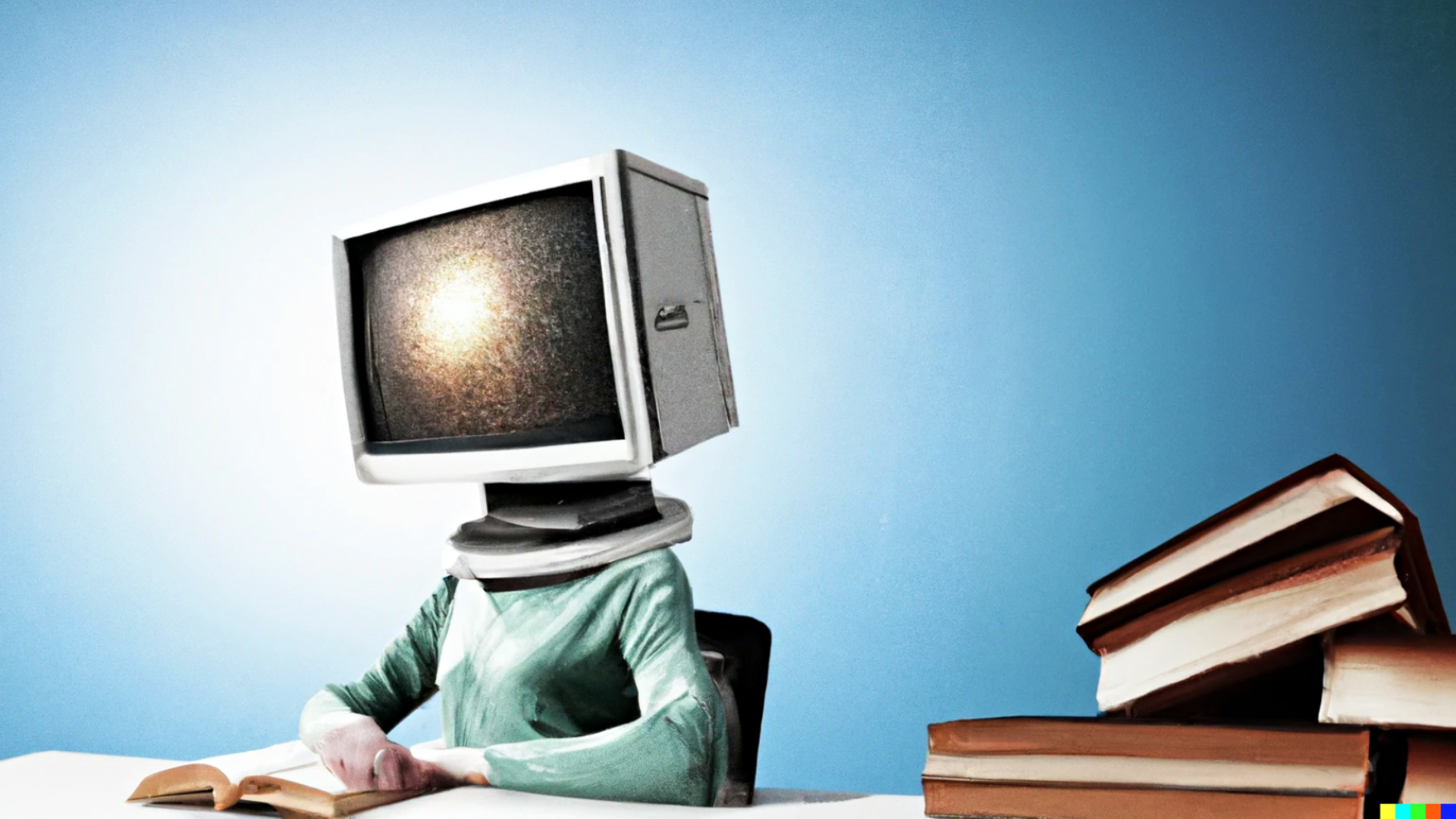

Nous discutons régulièrement des progrès constants des générateurs de texte en image comme DALL-E, mais l'émergence de l'IA pour le travail littéraire est passée quelque peu sous le radar. Selon une enquête récente de Motherboard, c'est une source de préoccupation pour les établissements d'enseignement.

Je veux dire, qui peut dire que vous ne lisez pas un article écrit par une machine en ce moment ?

Comment fonctionnent les outils d'IA linguistique ?

Jusqu'à très récemment, j'ignorais totalement qu'OpenAI - le développeur de DALL-E - disposait même d'algorithmes pour créer un langage original. Il s'avère qu'y parvenir n'est pas plus difficile que de créer des images absurdes.

En quelques secondes, le programme doublé GPT-3 peut prendre les invites de l'utilisateur et créer des paragraphes d'informations détaillés assemblés à partir du Web.

Un menu déroulant aide la technologie à se pencher sur une certaine discipline et un certain format de texte. Par exemple, sélectionner « Question » fournira des réponses simples, y compris des points de contact contextuels clés, et « Débat » génère des phrases originales sur un ton plus conversationnel.

Avec les bonnes invites pour le style et les informations, des réponses étendues peuvent être produites à partir de zéro, y compris des essais entiers. Comme vous pouvez l'imaginer, cela a le potentiel d'ouvrir une sérieuse boîte de Pandore pour les écoles, les collèges et les universités.

À l'heure actuelle, il est presque impossible de déterrer toute tentative de subversion, étant donné que les logiciels anti-plagiat ne peuvent détecter que des exemples de phrases ou de phrases répétées.

Bien que des cas de tricherie plus longs puissent ressortir à l'œil averti, la disparité entre la technologie de plagiat et l'IA ne fera que s'élargir avec la sortie du GTP-4 - qui aurait été formé sur 100 billions paramètres d'apprentissage automatique.

Les enfants utilisent l'IA pour rédiger des dissertations et se mettre au diapason pic.twitter.com/i0yyXiVEtU

– Peter Yang (@petergyang) 24 septembre 2022