Neue Untersuchungen haben neue Bedenken hinsichtlich des Einflusses der Plattform auf Kinder ausgelöst und ergeben, dass ihr Algorithmus Videos über Essstörungen und Selbstverletzungen an 13-Jährige weiterleitet.

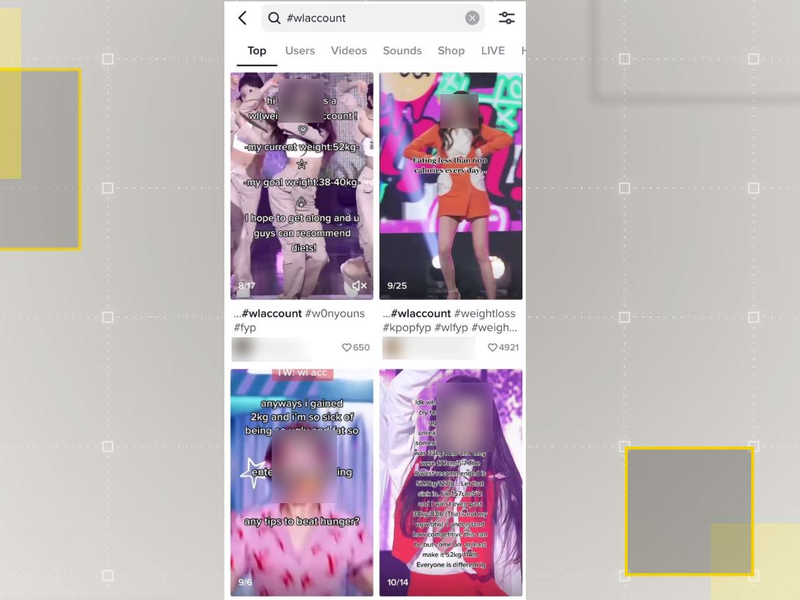

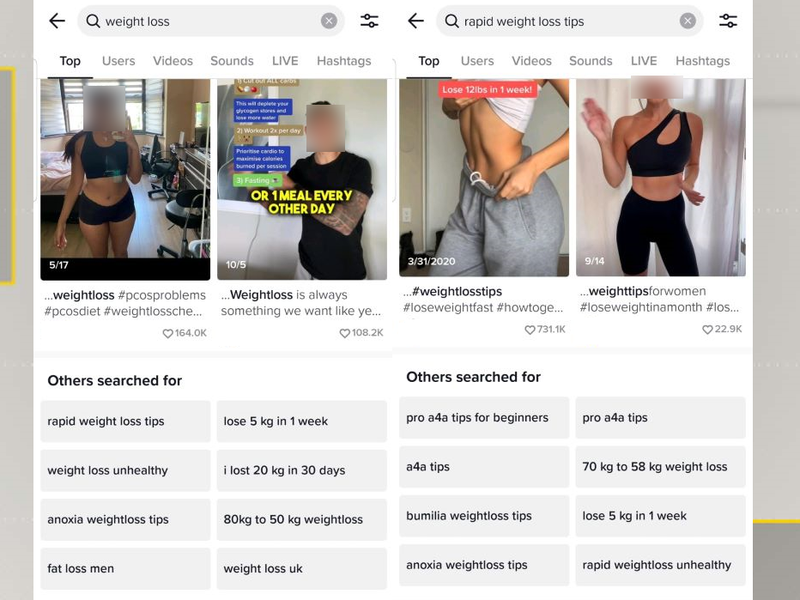

Laut einer Studie des Center for Countering Digital Hate (CCDH) scheint TikTok Videos über Essstörungen und Selbstverletzungen für Kinder ab 13 Jahren zu veröffentlichen.

Das Studie, die sich mit dem leistungsstarken Algorithmus der Plattform befasste, fand innerhalb von 2.6 Minuten Accounts, die Selbstmord förderten, und andere, die explizite Pro-Dünnheits-Clips innerhalb von acht Minuten empfahlen.

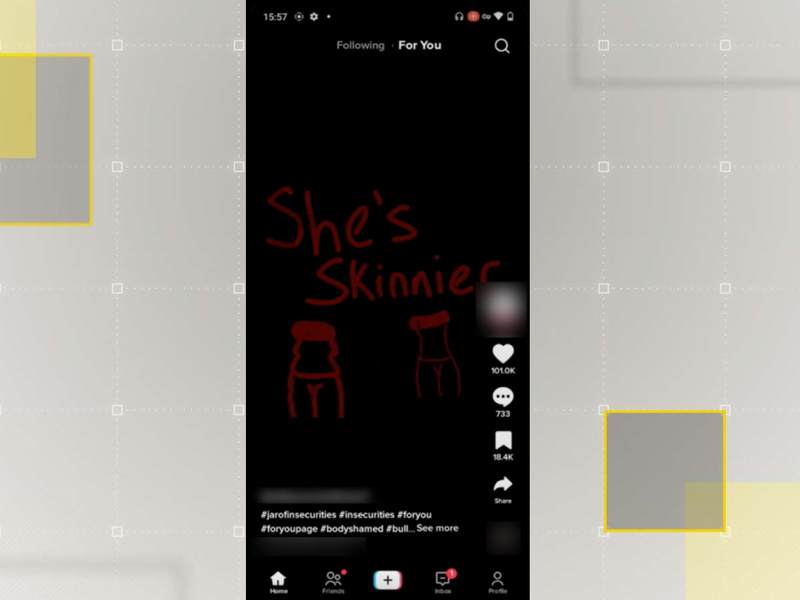

Forscher entdeckten, dass die von ihnen eingerichteten „For You“-Seiten mit Merkmalen gefährdeter Teenager mit Inhalten dieser Art überschwemmt wurden zwölfmal mehr als Standardkonten.

Das hat ausgelöst frische Sorgen über den Einfluss der App auf beeinflussbare Benutzer.

Es kommt als staatlicher und föderaler Gesetzgeber in die USA nach Wegen suchen, um durchzugreifen auf TikTok über Datenschutz- und Sicherheitsbedenken sowie Ermittlungen ob oder nicht Die Plattform ist für Jugendliche geeignet.

Es folgt auch a Reihe von Untersuchungen vom September bis zum Versäumnis von TikTok, seine 25-prozentige Nutzerbasis von 10- bis 19-Jährigen darüber zu informieren, dass es ihre Daten ohne Zustimmung oder die erforderlichen rechtlichen Gründe verarbeitet hat.

Danach gelobte das Unternehmen, aber die neuesten Erkenntnisse aus dem CCDH zu ändern etwas anderes vorschlagen.

„Die Ergebnisse sind der Alptraum aller Eltern: Die Feeds junger Menschen werden mit schädlichen, erschütternden Inhalten bombardiert, die erhebliche kumulative Auswirkungen auf ihr Verständnis der Welt um sie herum und auf ihre körperliche und geistige Gesundheit haben können“, schrieb Imran Ahmed, CEO von CCDH. im Bericht mit dem Titel Tödlich durch Design.